很多客服负责人都经历过这样的“鬼打墙”:

团队每天都在辛辛苦苦地分析聊天记录,向后台添加新的相似问和关键词,知识库里的条目从 1,000 条膨胀到了 10,000 条。但在月度复盘时,机器人的首解率 却始终在一个看不见的玻璃天花板下徘徊——通常是 60% 到 70% 之间。

为什么“勤奋”换不来“智能”? 如果您的团队正陷入这种瓶颈,那么继续堆砌关键词已经失效了。要冲击 85% 的高水位,我们需要一场从“匹配”到“理解”的技术代际升级。

本文将从认知、能力、执行、运营、风控五个维度,拆解如何利用大模型(LLM)与 Agent 技术,打破这一僵局。

一、 认知突围:承认“关键词匹配”的熵增极限

在传统模式下,机器人的“听懂”本质上是“猜中关键词”。

- 用户说:“我买给孩子的那个零食,他不爱吃,能换个口味吗?”

- 传统机器人:抓取到关键词“零食”、“口味”,大概率推送“产品介绍”或“热销榜单”。

- 真实意图:这是一次明确的“售后换货”诉求。

随着业务变复杂,您不得不配置成千上万条规则。一旦用户使用了口语化表达、倒装句,或者在一句话里夹杂了情绪宣泄(如“搞什么鬼,这么久才发货”),基于规则的系统就会失效。这不仅导致了大量的误识别,更让知识库的维护成本呈指数级上升,甚至出现“加了新规则反而干扰了旧规则”的冲突。

要突破 60% 的瓶颈,必须承认一个事实:依靠人工穷举用户语料的时代已经结束了。 我们需要的不是更多的关键词,而是能够理解上下文逻辑的“语义大脑”。

二、 能力重构:大模型如何听懂“弦外之音”?

如果要将首解率提升至 85% 以上,核心挑战在于处理剩下的那 20%-30% 的“长尾问题”——即那些表述模糊、逻辑复杂或含有隐性意图的咨询。

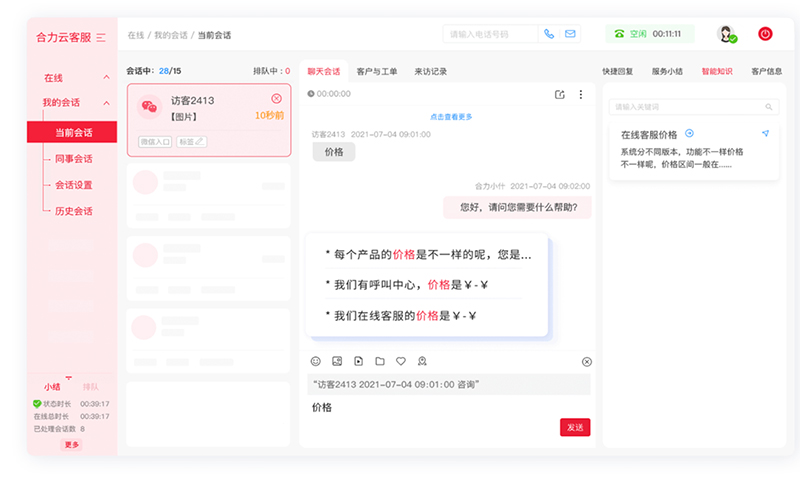

引入集成 DeepSeek、ChatGPT 等主流大模型能力的 AI Agent(智能体) 后,意图识别不再是做“填空题”,而是在做“阅读理解”。

我们来看一个真实的电商场景案例:

用户咨询:“我上周下单那个红色的礼盒,本来是要送人的,结果现在还没发货,你们要是再不发我就不要了,去别家买了。”

- Level 1(意图识别 - 显性):识别到“没发货”。

- Level 2(意图识别 - 隐性):识别到“催单”意图,且带有“投诉风险”(情绪负面)。

- Level 3(关键实体提取):提取出“上周的订单”、“红色礼盒”作为查询条件。

具备拟人化复杂交互能力的 Agent,能够突破关键词限制,理解同义词、反义词、时间表述(如“上周”)及口语化表达。它能精准地将上述那句充满情绪的话,结构化为:【意图:催发货】+【情绪:愤怒/高风险】+【实体:红色礼盒】。

实战验证:某头部零食品牌 该品牌面临全渠道超 10 个触点的海量咨询,且用户提问高度口语化(如“哪个零食适合追剧吃”)。传统 FAQ 机器人无法理解此类非标准问题。通过引入大模型在线客服 Agent,该品牌实现了对模糊需求的主动追问和精准意图挖掘。结果显示,智能客服的独立解决率提升至 85% 以上,首次响应时间降至 1 秒以内。

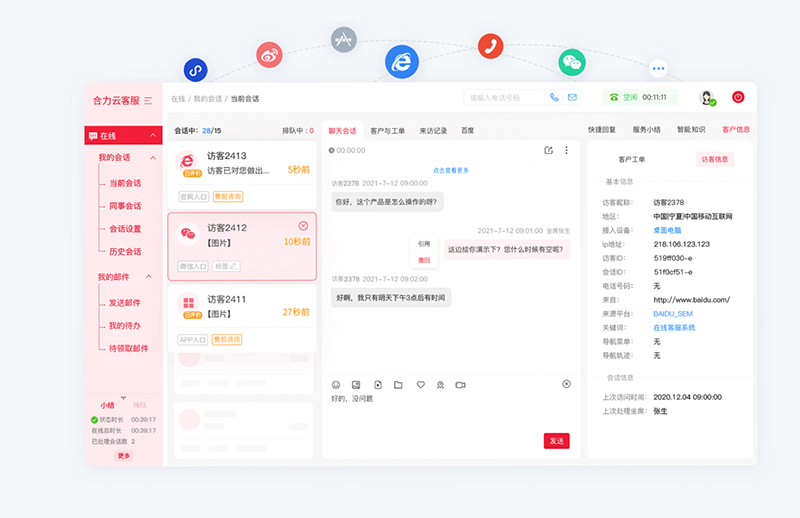

三、 执行落地:从“甩链接”到“办业务”

很多企业的机器人听懂了,但用户还是愤怒地转人工,为什么?因为机器人只会“甩链接”。

典型场景: 用户问“我的快递到哪了?”

- 传统做法:回复“亲,您可以点击下方链接查看。”(用户体验差,不想点)

- Agent 做法:意图识别不仅仅是匹配话术,更是触发动作的开关。

基于 LLM 的 Agent 编排平台,可以将企业的 CRM、ERP、订单系统封装成“工具”。

新一代交互流程:

1. 识别与提取:Agent 识别出 [查询物流] 意图,自动提取 [订单号]。

2. API 调度:Agent 判断需要调用“物流查询接口”,自主去业务系统拉取实时数据。

3. 结果生成:大模型将接口返回的 JSON 数据转化为自然语言:“亲,您的包裹刚刚到达深圳转运中心,预计明天送达。”

实战验证:某全球头部茶饮连锁品牌 通过 API 接口打通,其智能客服直接嵌入供应链系统。当门店店长咨询订货状态时,Agent 能实时读取订单信息并反馈,无需人工介入查询。这种“即问即办”的能力,使得话务与会话分配准确率达到 98%+,直接推高了自动化解决率。

四、 运营减负:历史文档“脏乱差”怎么洗?

升级系统时,最头疼的是历史遗留的、杂乱无章的知识文档。过去为了保证准确率,运营必须把手册拆解成成千上万个 FAQ。

现在,利用 RAG(检索增强生成) 技术,我们可以换一种高效打法:

- 零代码导入:直接将 Word、PDF、PPT 等原始业务文档扔进系统。

- 语义切片:系统自动切分并向量化存储。

- 大模型润色:用户提问时,系统检索相关片段,由大模型整合成通顺答案。

实战验证:某 5A 级旅游景区 面对复杂的票务政策和导览信息,该景区不再预拆分 FAQ,而是直接导入文档。结果维护成本降低了 70%,机器人能够回答“索道排队时间”等复杂问题,自主解决率稳定在 80%+。

五、 风险控制:给大模型加上“红绿灯”

企业最担心的不是机器人没答出来,而是“一本正经胡说八道”(幻觉)。冲击 85% 首解率,必须建立“红绿灯”置信度分级机制:

1. 🟢 绿灯区(高置信度):事实性问题(如查余额、查地址),模型置信度 > 0.9,直接回答或执行。

2. 🟡 黄灯区(中置信度):拿不准的问题(置信度 0.6-0.9),采用“澄清/反问”策略,或给出选项让用户点选,把填空题变成选择题。

3. 🔴 红灯区(高风险):识别出“投诉”、“情绪激动”或法律合规问题,Agent 立即停止生成,无缝将完整上下文同步给人工坐席,实现零摩擦切换。

结语:从“工具”到“员工”

将客服机器人的首解率从 60% 提升至 85%,不仅仅是 KPI 的优化,更是一场交付范式的革命。

- 过去,我们将机器人视为“工具”,试图用穷举法教会它所有规则。

- 现在,我们应当将其视为“数字员工”,通过大模型赋予它理解能力(听懂),通过 Agent 赋予它执行能力(办事),通过 RAG 赋予它学习能力(查文档)。

对于企业服务管理者而言,现在的当务之急,不是去后台再加 100 个关键词,而是重新审视您的技术架构——您的机器人,是在做填空题,还是在做阅读理解?

常见问题解答 (FAQ)

Q1: 引入大模型会让客服系统的成本飙升吗? A: 不一定。 虽然大模型单次调用有成本,但通过 RAG 技术,您节省了大量人工编写和维护 FAQ 的人力成本。此外,现在的 Agent 平台支持灵活切换模型,您可以在处理简单问题时使用低成本模型,仅在处理复杂意图时调用高性能大模型,实现 ROI 最大化。

Q2: 我们的业务系统很老旧,也能对接 Agent 吗? A: 可以。 只要您的 CRM 或订单系统具备标准的 API 接口,Agent 编排平台就能将其封装为“工具”。您不需要推倒重来,只需通过中间层打通,就能让老系统焕发智能新活力。

Q3: 知识库文档更新频繁,RAG 模式能及时响应吗? A: 绝对可以。 相比传统需要人工重新配置关键词和答案,RAG 模式下只需上传最新的 PDF 或 Word 文档,系统即可自动完成切片更新。对于促销活动频繁变动的零售行业,这能确保机器人回复的时效性达到分钟级。

如需智能客服、AI客服机器人产品,请联系【亿捷云智能客服】,联系电话: 4006-345-690