如今,越来越多的企业和平台开始使用AI在线客服。它们能秒回消息、24小时待命,甚至还能通过对话“猜”出你的需求,确实让沟通变得更方便了。但每次点开那个对话框时,很多人心里都会犯嘀咕:我和AI聊的内容会被记录吗?输入的个人信息会不会被泄露?今天咱们就聊聊这事儿,看看AI客服背后藏着哪些数据安全门道,咱们普通人又该怎么保护自己。

一、AI客服需要“记住”多少信息?

AI在线客服的核心能力来源于数据训练。简单来说,它得先“学习”大量对话记录、用户行为数据,才能理解咱们的问题。比如你问“订单怎么退款”,AI得知道你的账号信息、订单记录才能回答。这就涉及几个关键点:

1. 基础数据:包括账号、手机号、地址等(用于验证身份);

2. 行为数据:搜索记录、点击行为、停留时长(用于分析需求);

3. 对话内容:文字、语音甚至表情包(用于优化服务)。

但问题来了:这些数据会被永久保存吗?会不会被挪作他用?其实正规的AI系统在设计时都会遵循“最小必要原则”——只收集完成任务必需的数据,且存储时间有限。比如你咨询完快递问题,相关对话可能几个月后就被自动清除了。

二、数据泄露的“高危环节”在哪?

即便AI客服本身很“守规矩”,数据流转过程中仍存在风险点:

1. 存储环节

数据保存在服务器上时,可能面临两种情况:

内部泄露:员工越权访问、误操作导出数据;

外部攻击:黑客入侵窃取信息。

应对措施:

企业需设置严格的访问权限(比如“一人一密匙”);

部署防火墙、入侵检测系统。

2. 传输环节

当你的问题从手机传到服务器时,如果网络通道没加密,就像寄快递没封箱,中途可能被“拆包偷看”。

解决方案:

全程使用HTTPS等加密协议;

对敏感信息(如身份证号)进行二次加密。

3. 第三方合作风险

有些AI客服系统会调用外部数据库或接口,一旦合作方数据管理不规范,就可能“城门失火殃及池鱼”。

三、技术如何给隐私“上锁”?

1. 匿名化处理

把数据中的个人信息(如姓名、电话)替换成随机代码。比如把“张三 138xxxx订了咖啡机”变成“用户A 购买了厨房电器”,这样即便数据泄露,也无法关联到具体个人。

2. 联邦学习

让AI“学知识但不记细节”。比如10个商家的客服系统共同训练AI,但每家只能看到自家用户的模糊化数据,既提升了AI能力,又避免了数据集中暴露。

3. 端侧计算

敏感操作直接在用户设备上完成。比如你问“我的账户余额多少”,AI在本地调取数据并回答,相关记录压根不上传服务器。

四、普通人能做什么?

技术防护是基础,但咱们自己也得长点心:

1. 别在对话框里“掏家底”

银行卡密码、身份证照片、家庭住址这些,除非必要否则不提供。遇到索要敏感信息的情况,先确认对方身份。

2. 定期清理对话记录

就像删聊天记录一样,很多平台支持手动删除历史咨询。

3. 留意隐私条款

别直接点“同意”,重点看“数据存储时间”“是否共享给第三方”这两项。

五、未来会更好吗?

随着《个人信息保护法》等法规落地,国家对数据安全的监管越来越严。技术层面,隐私计算、区块链等新工具也在不断升级防护手段。当然,完全“零风险”的网络环境并不存在,但通过企业规范运营、技术持续迭代、用户提高警惕,咱们完全可以大幅降低隐私泄露的概率。

说到底,AI客服用不用,关键看你怎么权衡便利和风险。只要记住“敏感信息不乱给,隐私条款仔细读,定期清理旧数据”这三招,就能在享受科技红利的同时,给自己的隐私多上一道保险栓。

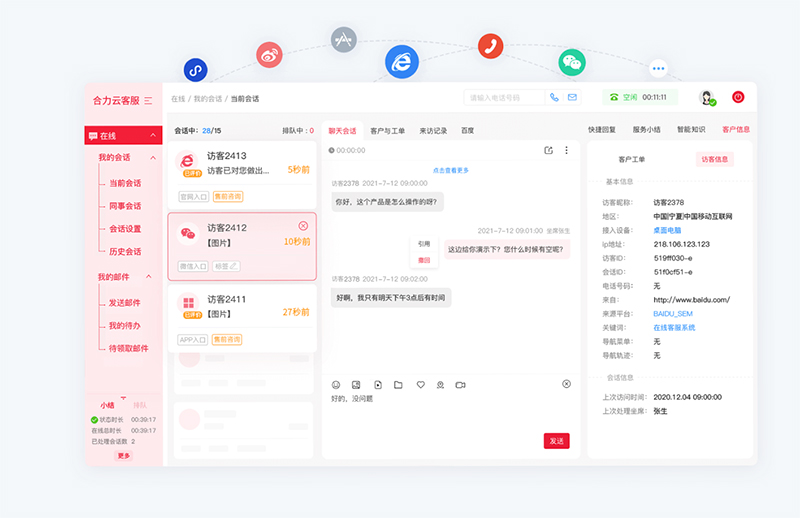

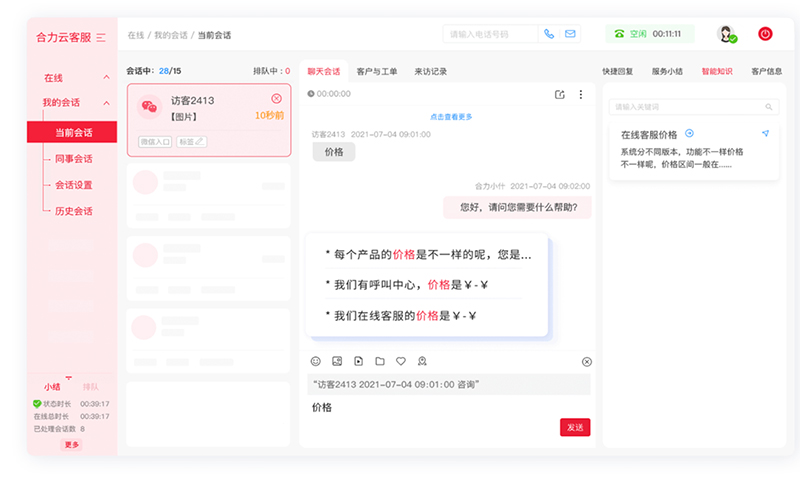

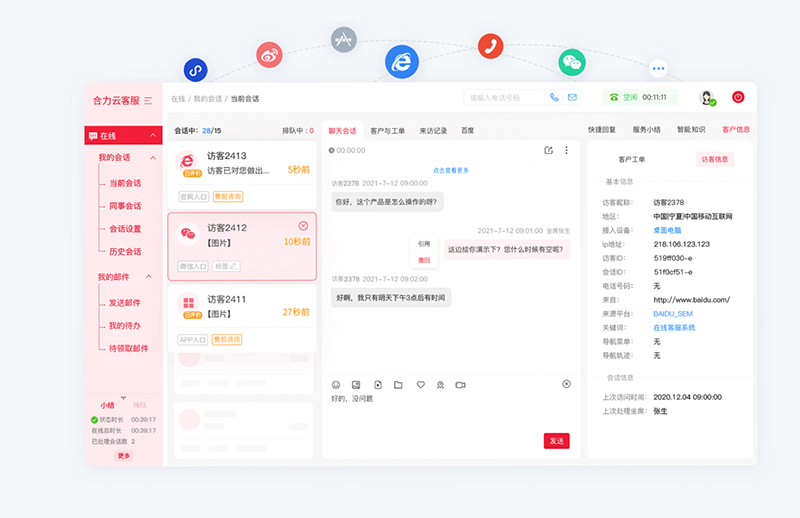

亿捷云客服基于AI大模型驱动智能客服机器人,集成了自然语言处理、语义理解、知识图谱、深度学习等多项智能交互技术,解决复杂场景任务处理,智能客服ai,精准语义理解,意图识别准确率高达90%。

如需智能客服、AI客服机器人产品,请联系【亿捷云客服】,联系电话: 4006-345-690