用着AI客服聊得正嗨,突然被转接给真人客服——这种无缝切换背后,其实藏着不少技术“暗礁”。今天咱们就拆解人机协作在AI客服系统中的五个技术难点,看看工程师们是如何“见招拆招”的。

一、意图识别:听懂人话比想象中难

AI客服的第一关是准确理解用户需求,但人类的语言实在太“善变”。比如用户问:“我的订单怎么还没到?”这句话可能是催促发货、查询物流,甚至隐含着投诉意图。

难点核心:口语化表达、方言、一词多义等问题,导致AI容易“会错意”。例如“帮我取消”和“取消帮我”仅调换词序,语义却完全相反。当前主流方案依赖NLP(自然语言处理)模型训练,但训练数据的覆盖度和质量直接决定识别准确率,稍有不慎就会闹出“鸡同鸭讲”的笑话。

二、上下文理解:AI的“记忆力”考验

人机协作中,AI需要记住对话历史才能做好交接。比如用户先问“如何退换货”,接着追问“运费谁承担”,如果AI忘记前文,可能给出矛盾的回答。

技术卡点:

1. 多轮对话关联:如何让AI精准关联分散在多次对话中的关键信息?

2. 场景跳跃处理:用户突然切换话题时(如从咨询产品转向投诉服务),AI能否快速识别并调整策略?

目前主流技术通过“对话状态跟踪”记录上下文,但面对复杂场景时仍可能“断片”,导致真人客服接手后需要用户重复描述问题。

三、人机切换:交给人工的时机怎么选?

什么时候该把用户转给真人?转得太早,浪费人力;转得太晚,激怒用户。这个“交接临界点”的判定堪称玄学。

决策逻辑的两难:

规则派:预设条件(如用户三次提问未解决),但灵活性差;

算法派:通过情绪识别、问题复杂度评分动态判断,但模型训练成本高。

举个栗子,用户说“我要投诉”可能直接触发转接,但如果他接着说“但先告诉我怎么退款”,AI就需要重新评估是否继续服务。这种动态博弈对系统的实时判断能力要求极高。

四、数据安全:隐私保护的“走钢丝”

人机协作意味着用户数据会在AI和人工客服间流转。聊天记录中的手机号、订单信息一旦泄露,企业可能面临法律风险。

隐形雷区:

信息过度暴露:真人客服是否需要看到全部对话记录?

临时数据存储:交接过程中的缓存信息如何及时清理?

目前行业主要通过数据脱敏(隐藏关键信息)、权限分级来控制风险,但如何在保障服务效率的同时“锁住”隐私,仍是长期课题。

五、自我进化:AI如何“越用越聪明”?

优秀的人机协作系统应该能从人工服务中学习经验。比如真人客服处理过某个复杂咨询后,AI下次能否独立解决同类问题?

学习瓶颈:

1. 知识抽取:从非结构化的对话记录中提取有效信息;

2. 增量训练:频繁更新模型可能导致原有能力退化(业内称为“灾难性遗忘”)。

这就好比让AI在不停学新知识的同时,还不能忘记旧技能——目前主要通过建立独立知识库和小样本学习技术缓解,但离真正的“知行合一”还有差距。

总结:技术没有完美,只有持续优化

人机协作不是简单的“AI不行就换人”,而是一场精密的技术交响乐。从意图识别到自我进化,每个环节都在考验系统的智能水位。好在随着大模型、多模态交互等技术的发展,这些问题正在逐步破解。也许不久的将来,用户再也感受不到AI和人工的切换边界——而这,正是技术进化的终极目标。

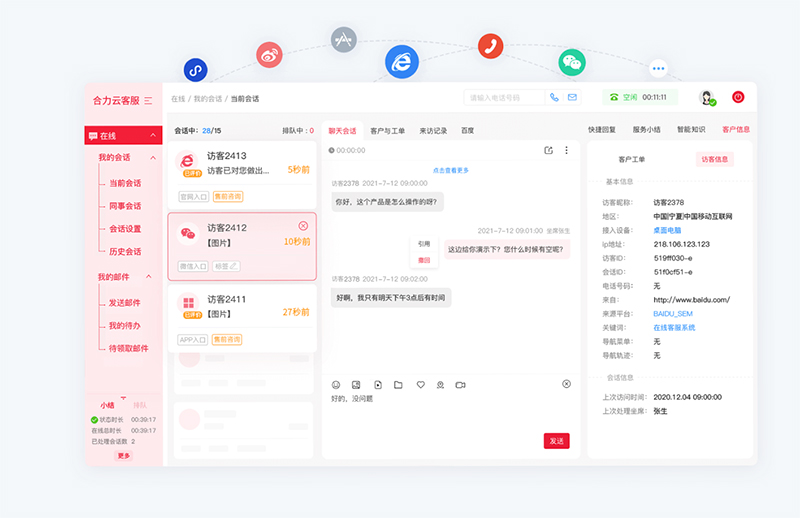

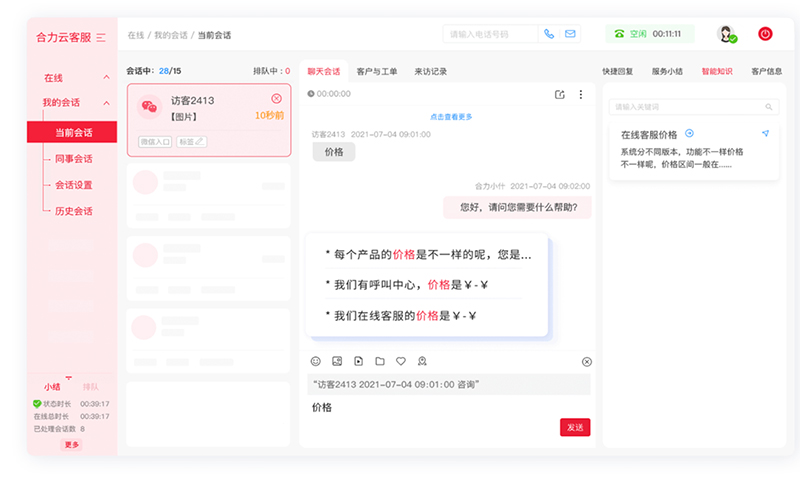

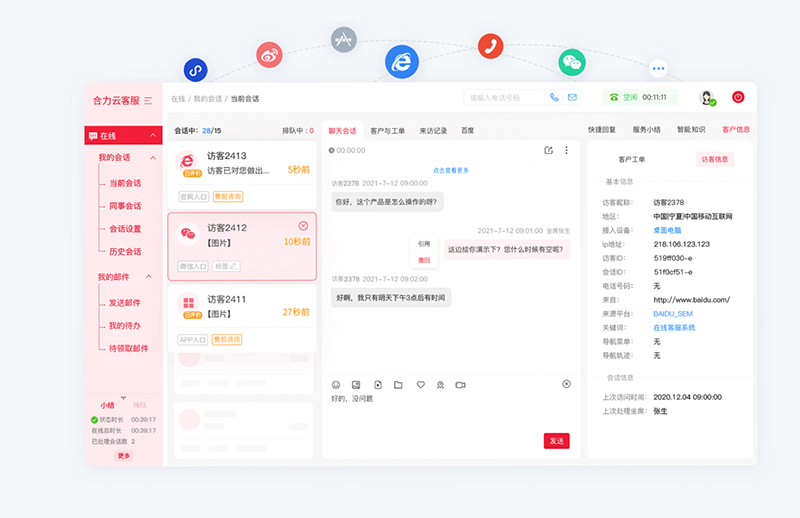

亿捷云客服基于AI大模型驱动智能客服机器人,集成了自然语言处理、语义理解、知识图谱、深度学习等多项智能交互技术,解决复杂场景任务处理,智能客服ai,精准语义理解,意图识别准确率高达90%。

如需智能客服、AI客服机器人产品,请联系【亿捷云智能客服】,联系电话: 4006-345-690